Написати текст, розв’язати математичну задачу, згенерувати код чи картинку — алгоритми ШІ на відмінно можуть впоратись практично з будь-яким завданням. Що й казати, «суцільна» автоматизація не могла пройти й повз медіапростір. Та чи не стало це загрозою? У чому полягає небезпека та чи можна їй протидіяти?

Нещодавно у ХНУРЕ відбувся 29 Міжнародний молодіжний форум «Радіоелектроніка та молодь у ХХІ столітті», в якому я під час участі досліджувала тему маніпулятивних впливів ШІ в медіа. І зараз хочу поділитися з вами найцікавішим із того, що вдалося з’ясувати.

У чому загроза?

ШІ — ідеальний інструмент для швидкої, простої, якісної й дешевої генерації медіаповідомлень. Ці переваги, на жаль, широко використовують для створення і поширення пропаганди та дезінформації. Такий контент розповсюджується миттєво й охоплює надвелику кількість людей. Основна причина — автоматизація публікації та значні прогалини у модерації соцмереж. Приміром, алгоритмізація поширення у Тік-Ток чи відсутність адекватної цензури дезінформації в Х.

Цікаво, що для генерації маніпулятивних повідомлень використовують як спеціалізовані ШІ-програми, так і загальнодоступні моделі. Спеціалізовані програми — навчені на пропагандистських матеріалах, емоційних текстах та відео. Їх призначення — створювати подібний контент. Водночас загальнодоступні моделі зазвичай мають етичні обмеження, однак за відповідного використання також можуть бути джерелами маніпуляцій.

Двійництво та дипфейки

Важко не погодитися, що саме завдяки ШІ поняття «двійництво» здобуло особливу популярність в медіа. Серед основних проблем і дипфейк — високоякісна медіапідробка. Як ви, мабуть, знаєте, це сфальсифіковані фото, відео і навіть інфоресурси з метою використання авторитету чи дискредитації.

Наприклад, у межах російської дезінформаційної операції Doppelganger (злий двійник) використовуються клони легітимних сайтів інформагентств. Мета — поширення російських наративів під виглядом авторитетних ЗМІ. На веб-сторінках розміщують пропагандистські матеріали адаптовані до конкретних країн і покликані поширювати євроскептицизм, політичну поляризацію та маніпулятивний контент щодо України.

Що не так з чат-ботами?

Занепокоєння викликають і чат-боти, якими ми користуємося мало не щодня. Може здатися, що такий «помічник», як ChatGPT чи Copilot, за нормальних умов не здатний видавати суперечливі (з етичного погляду) відповіді. Однак, у дослідженні News Guard, де було проаналізовано роботу десяти найпоширеніших чат-ботів, було відзначено, що вони з високою ймовірністю схильні повторювати наративні твердження, особливо якщо користувач надає ствердний запит. Це лише посилює інформаційну бульбашку користувача.

ШІ проти ШІ: парадокс сучасності

Варто визнати, що наразі ШІ — єдиний технологічний засіб, який може нейтралізувати негативні медіавпливи ШІ. Адже здатний охопити маніпулятивну інформацію в тих об’ємах і з тією швидкістю, з якою вона поширюється.

Яскравим прикладом такого застосування ШІ є український стартап Mantis Analytics, який з’явився як відповідь на гібридну війну Росії проти України. Засоби проєкту здатні моніторити понад 600 тисяч інфо повідомлень на день у режимі реального часу. На основі 18 науково обґрунтованих маніпулятивних технік алгоритми ШІ знаходять дезінформацію та пропаганду, а потім формують звіт з підсумками.

Ідеальний варіант врегулювання

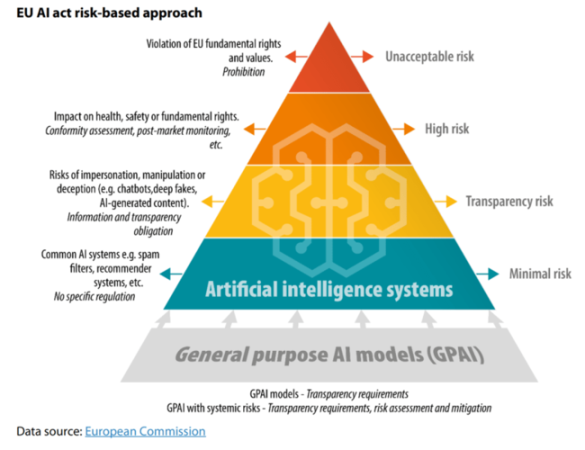

Для того, щоб ШІ підкорявся певним етичним правилам, вони мають бути чітко визначеними й обов'язковими для розробників і користувачів. Саме тому найголовніший крок до врегулювання проблеми ШІ — створення відповідного законодавства.

Впродовж довгого часу важелем впливу у сфері ШІ були петиції та відкриті листи, такі, як «Asilomar AI Principles» (23 ціннісні принципи ШІ) чи «Pause Giant AI Experiments: An Open Letter» (заклик призупинити активну фазу розробок для врахування етичних потреб).

А зовсім нещодавно, 1 серпня 2024 року, в ЄС набув чинності перший у світі комплексний закон про ШІ — Artificial Intelligence Act. Проте його впровадження ще триває, а засоби контролю над його виконанням здаються досить примарними. На жаль, «закону» поки що не вганятися за сучасними технологіями.

Наша головна зброя — медіаграмотність

Саме тому найдієвішим засобом протидії маніпулятивним впливам ШІ в медіа є наша обізнаність щодо мети, засобів, можливостей і ризиків пов'язаних з розвитком і використанням цієї технології. Медіаграмотність, в тому числі стосовно ШІ, допоможе вирізняти маніпулятивний контент, розуміти, як та навіщо він був створений. Ми не можемо повністю подолати негативні наслідки маніпуляцій в медіа, однак можемо фільтрувати те, як ми на них реагуємо.

Додатковим фактором стримування може стати виявлення і маркування маніпулятивного контенту, згенерованого ШІ, на рівні публікації й поширення — тобто у ЗМІ та соцмережах.

Варто розуміти, що проблема маніпулятивних впливів ШІ в медіа полягає не в самій технології, а в тому, як людство її використовує. Враховуючи нестабільність сучасного світу та різницю у поглядах всередині суспільства, завжди знайдуться особи, які бажають поширювати свій вплив, формуючи в людей потрібні емоції та переконання. ШІ — лише інструмент для цього.

Саме тому описана проблема має знайти глобальне врегулювання у вигляді законодавства, яке ґрунтуватиметься на тому, що ШІ має служити людству на благо. З іншого боку, ми й самі маємо поставитися до цього питання з належною відповідальністю. Піти від маніпуляцій неможливо — вони існуватимуть завжди. Проте є шанс мінімізувати їх вплив на масову свідомість завдяки належній цифровій освіті й обізнаності серед населення.

За матеріалами:

- https://netfreedom.org.ua/article/temnij-bik-shtuchnogo-intelektu-yak-shi-pidsilyuye-rosijsku-propagandu

- https://www.holosameryky.com/a/vybory-dipfejky/7682740.html

- https://www.dw.com/uk/stucnij-intelekt-dla-propagandi-ak-cogo-uniknuti/a-69415996

Василина Яблонь